- Autora Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:44.

- Última modificació 2025-01-22 17:20.

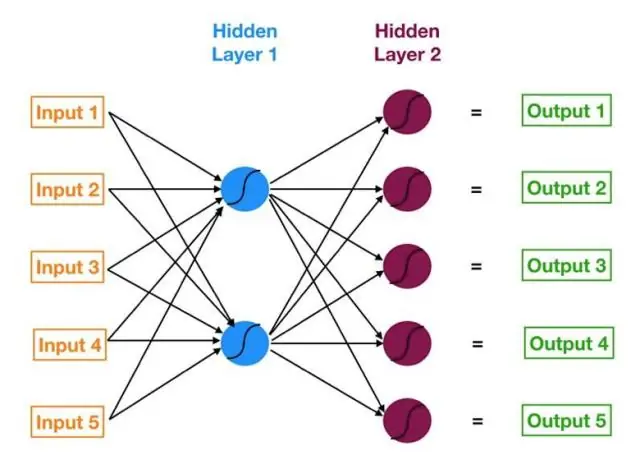

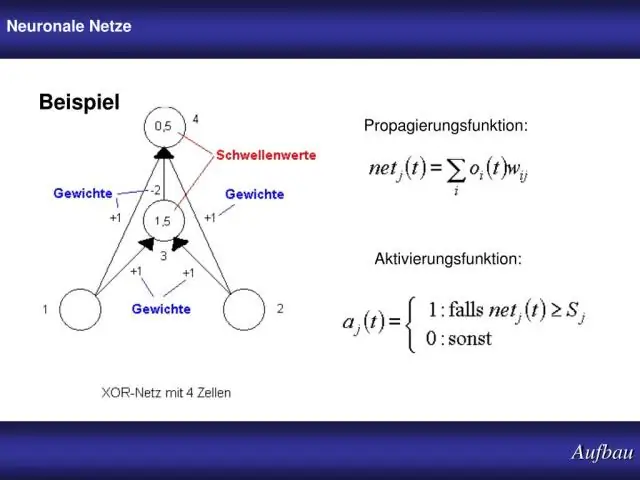

A multicapa perceptron (MLP) és una classe de feedforward artificial xarxa neuronal (ANN). Un MLP consta d'almenys tres capes de nodes: una capa d'entrada, una capa oculta i una capa de sortida. Excepte els nodes d'entrada, cada node és a neurona que utilitza una funció d'activació no lineal.

De la mateixa manera, es pregunta, com aprèn una xarxa neuronal multicapa?

Xarxes multicapa resoldre el problema de classificació de conjunts no lineals emprant capes ocultes, les neurones de les quals són no connectat directament a la sortida. Les capes ocultes addicionals llauna s'interpretarà geomètricament com a hiperplans addicionals, que milloren la capacitat de separació de la xarxa.

A més, per què utilitzar diverses capes en una xarxa neuronal? A xarxa neuronal utilitza una funció no lineal en cada cas capa . Dos capes significa una funció no lineal d'una combinació lineal de funcions no lineals de combinacions lineals d'entrades. El segon és molt més ric que el primer. D'aquí la diferència de rendiment.

Tenint-ho en compte, com funciona un Perceptrón multicapa?

A perceptró multicapa (MLP) és un profund, artificial xarxa neuronal . Es componen d'una capa d'entrada per rebre el senyal, una capa de sortida que pren una decisió o predicció sobre l'entrada i, entre aquestes dues, un nombre arbitrari de capes ocultes que són el veritable motor computacional de la MLP.

Què és la funció sigmoide a la xarxa neuronal?

En l'àmbit de l'Artificial Xarxes neuronals , el sigmoide La funció és un tipus d'activació funció per a les neurones artificials. El Funció sigmoide (un cas especial de la logística funció ) i la seva fórmula sembla: Podeu tenir diversos tipus d'activació funcions i són més adequats per a diferents finalitats.

Recomanat:

Podeu connectar una interfície de xarxa en una VPC a una instància d'una altra VPC?

Podeu crear i connectar una interfície de xarxa addicional a qualsevol instància del vostre VPC. El nombre d'interfícies de xarxa que podeu connectar varia segons el tipus d'instància. Per obtenir més informació, consulteu Adreces IP per interfície de xarxa per tipus d'instància a la Guia d'usuari d'Amazon EC2 per a instàncies de Linux

Com es fa una xarxa neuronal a Python?

Els següents són els passos que s'executen durant la fase de feedforward d'una xarxa neuronal: Pas 1: (Calculeu el producte escalat entre entrades i pesos) Els nodes de la capa d'entrada es connecten amb la capa de sortida mitjançant tres paràmetres de pes. Pas 2: (passeu el resultat del pas 1 a través d'una funció d'activació)

Com funciona una xarxa neuronal de manera senzilla?

La idea bàsica darrere d'una xarxa neuronal és simular (copiar d'una manera simplificada però raonablement fidel) un munt de cèl·lules cerebrals densament interconnectades dins d'un ordinador perquè pugueu aprendre coses, reconèixer patrons i prendre decisions d'una manera humana. Però no és un cervell

Què fa la funció d'activació a la xarxa neuronal?

Les funcions d'activació són equacions matemàtiques que determinen la sortida d'una xarxa neuronal. La funció s'adjunta a cada neurona de la xarxa i determina si s'ha d'activar ("despedida") o no, en funció de si l'entrada de cada neurona és rellevant per a la predicció del model

Com funciona la xarxa neuronal d'alimentació?

La xarxa neuronal feedforward va ser el primer i més simple tipus de xarxa neuronal artificial dissenyada. En aquesta xarxa, la informació només es mou en una direcció, cap endavant, des dels nodes d'entrada, passant pels nodes ocults (si n'hi ha) i fins als nodes de sortida. No hi ha cicles ni bucles a la xarxa